【資安宣導】AI 軟體與服務可能產生之風險疑慮

發佈日期 :

2025-11-05

最後更新日期 :

2025-11-05

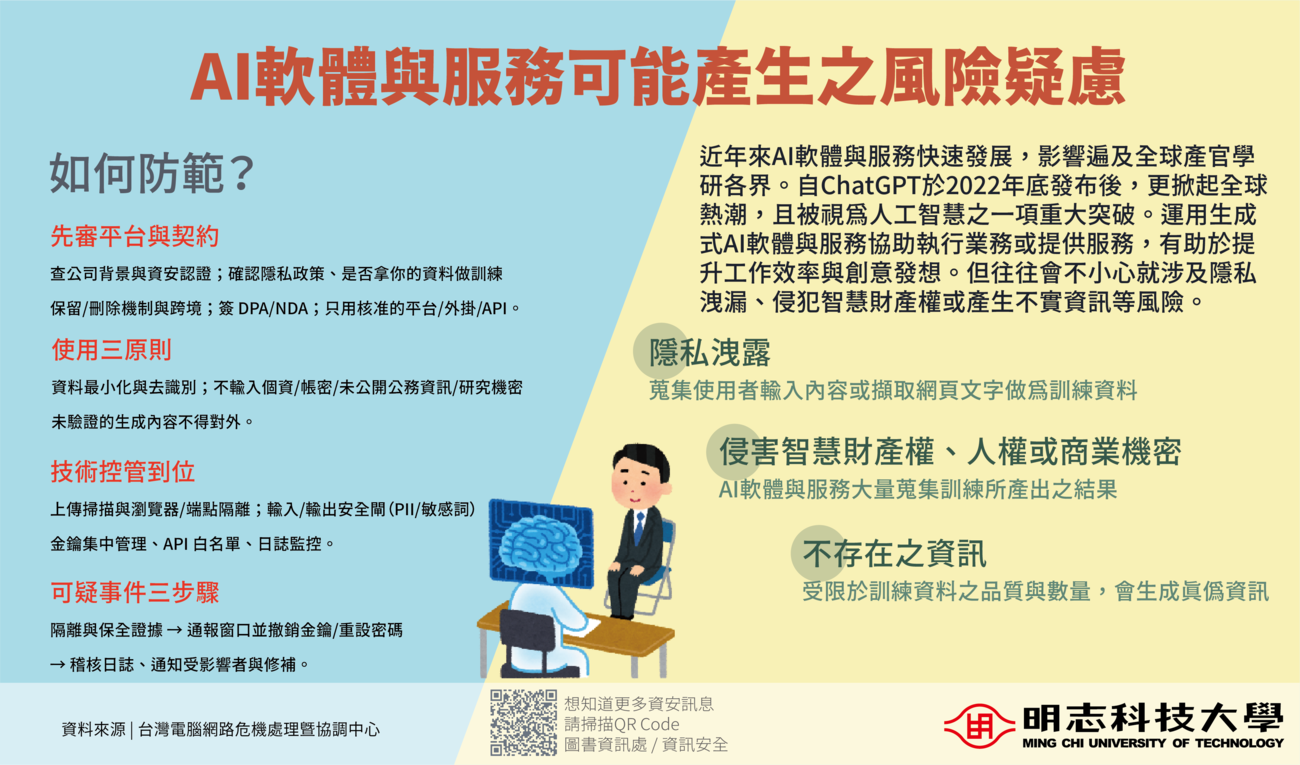

AI軟體與服務可能產生之風險疑慮

近年來AI軟體與服務快速發展,影響遍及全球產官學研各界。自ChatGPT於2022年底發布後,更掀起全球熱潮,且被視為人工智慧之一項重大突破。

運用生成式AI軟體與服務協助執行業務或提供服務,有助於提升工作效率與創意發想。

但往往會不小心就涉及隱私洩漏、侵犯智慧財產權或產生不實資訊等風險。

-

隱私洩漏

蒐集使用者輸入內容或擷取網頁文字做為訓練資料

-

侵害智慧財產權、人權或商業機密

AI軟體與服務大量蒐集訓練所產出之結果

-

不存在之資訊

受限於訓練資料之品質與數量,會生成真偽資訊

如何防範?

-

先審平台與契約

查公司背景與資安認證;確認隱私政策、是否拿你的資料做訓練保留/刪除機制與跨境;簽 DPA/NDA;只用核准的平台/外掛/API。

-

使用三原則

資料最小化與去識別;不輸入個資/帳密/未公開公務資訊/研究機密未驗證的生成內容不得對外。

-

技術控管到位

上傳掃描與瀏覽器/端點隔離;輸入/輸出安全閘(PII/敏感詞)金鑰集中管理、API 白名單、日誌監控。

-

可疑事件三步驟

隔離與保全證據 → 通報窗口並撤銷金鑰/重設密碼→ 稽核日誌、通知受影響者與修補。

承辦單位:

電算中心